منذ سنوات، وأنا أُكرّر في كل مناسبة جملةً واحدة لم يُصدّقني فيها كثيرون: “النماذج اللغوية لا تفهم، إنها تُطابق الأنماط وتحفظها”. وكان الردّ دائمًا مزيجًا من التشكيك والاستهزاء: “أنت تُبالغ”، “الذكاء الاصطناعي يُفكّر الآن فعلًا”، “أنت لا تُواكب التطورات”.

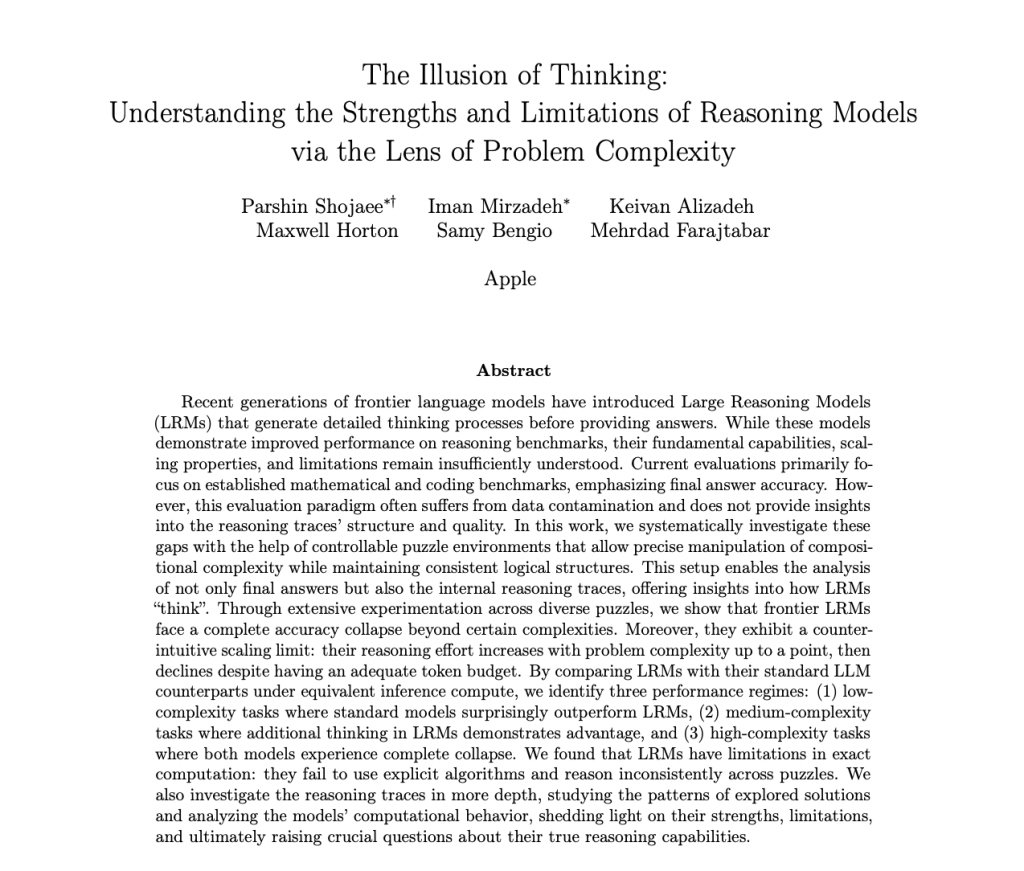

ثم جاءت آبل في يونيو 2025 بما يُسمّيه الباحثون “صفعةً للصناعة”، نشرته في ورقة بحثية صدرت عن مختبر تعلّم الآلة لديها، بعنوان لافت: “وهم التفكير”.

ما الذي فعله باحثو آبل؟

لم يكتفِ الباحثون بالنظر إلى إجابات النماذج النهائية كما يفعل الجميع. بل ذهبوا أعمق، درسوا آليّة “التفكير” ذاتها، وتتبّعوا خطواتها، وحلّلوا مسار الاستدلال داخل النموذج خطوةً بخطوة.

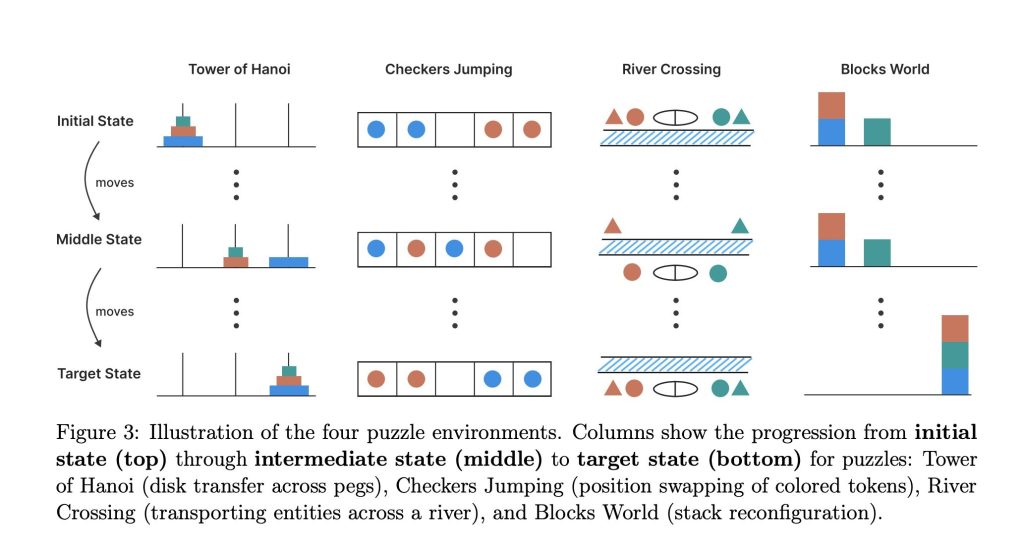

الأدوات التي استخدموها كانت بسيطة لكنها ذكية: ألغاز منطقية كلاسيكية قابلة للتحكم في درجة تعقيدها، مع الحفاظ على البنية المنطقية ثابتة. ومن أبرز هذه الألغاز كان لغز الفلاح الشهير.

فكّر في هذا اللغز: فلاح يريد نقل ذئب وماعز وعلف عبر النهر في قارب لا يتسع إلا لكائن آخر معه، ولا يستطيع أن يترك الذئب مع الماعز أو الماعز مع العلف، هل بمقدور الذكاء الاصطناعي الإجابة على هذا اللغز؟ طبعًا!

ولكن هل مصدر الإجابة التفكير أم البحث في نتائج مخزّنة مسبقًا؟

هنا تكمن العبقرية في منهجية آبل: قام الباحثون باستخدام نفس تركيبة لغز الفلاح وألغاز أخرى مشابهة، لكنهم زادوا مستوى صعوبتها بإضافة عناصر جديدة، مثل كلب أو دجاجة إلى قائمة المخلوقات التي يجب نقلها، وغيّروا العلاقة بين هذه العناصر (الكلب لا يمكن تركه مع الذئب أو الماعز).

هذه الآلية تضمن تعريض الذكاء الاصطناعي لمسائل لم يتعامل معها مسبقًا من خلال بيانات التدريب، وبالتالي لا تتوفر الإجابة عليها في ذاكرة النموذج، وفي الوقت نفسه، هذه الألغاز يمكن حلّها لو كان الذكاء الاصطناعي يملك قدرات تفكير وتحليل حقيقية.

هذه الآلية تتفوّق على طرق الاختبار السائدة التي تعتمد على المسائل الرياضية أو الاختبارات المعيارية لتقييم أداء النماذج اللغوية. مشكلة الاختبارات السائدة أنها تجعل تحديد ما إذا كان مصدر الإجابة التفكيرَ والتحليل أم مجرد الحفظ والبحث في الذاكرة أمرًا عسيرًا.

ما الذي وجدوه؟

النتيجة كانت صادمة لمن آمن بقصة “الذكاء الاصطناعي يُفكّر”. كشف الباحثون عن أربعة أنماط سلوكية جوهرية:

1) المبالغة في حلّ المسائل البسيطة

عند التعامل مع ألغاز متدنية الصعوبة، واصلت النماذج اللغوية المُفكّرة البحثَ عن حلول إضافية حتى بعد الوصول إلى الحل الصحيح، كطالب يكتب صفحةً كاملة في إجابة يكفيها سطر، وهذا عيب جوهري، لأن الكفاءة في الوصول إلى الحل خاصية لا غنى عنها في أي منظومة تفكير حقيقية.

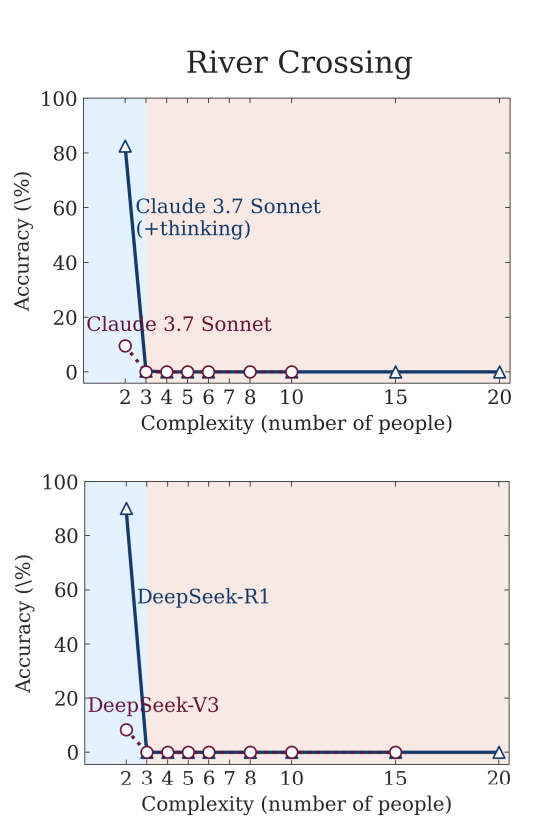

2) الانهيار الكامل عند التعقيد العالي

عند التعامل مع ألغاز أكثر صعوبة، كلغز الفلاح لكن بعدد أكبر من المخلوقات وتعقيد أكبر في العلاقة بينها، عجزت هذه النماذج عن الوصول إلى أي حل صحيح، والأغرب أنها بذلت جهدًا أقل في محاولة إيجاد الحل كلما اشتدت الصعوبة، وهو دليل إضافي على أن ما تقوم به هو بحث في الذاكرة وليس تفكيرًا مستقلًا.

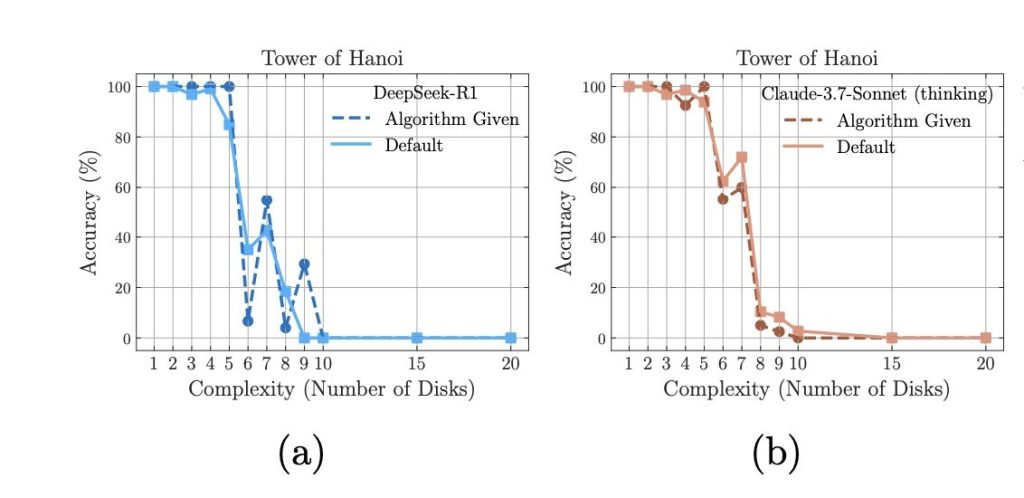

3) العجز عن اتباع التعليمات

قام الباحثون بتزويد النماذج اللغوية بإرشادات محددة لحل الألغاز الصعبة جدًا، فوجدوا أن هذه المساعدة لم تُحسّن الأداء، بل واصلت النماذج إيجاد حلول خاطئة رغم وجود تعليمات واضحة للوصول إلى الحل الصحيح، فالعجز عن اتباع التعليمات سلوك محيّر وعيب جوهري.

4) عدم الاتساق بين الألغاز

من النتائج المحيّرة في الورقة أن النماذج لم تستخدم المنهجية ذاتها في تحليل الألغاز، وتجاهلت حِيَلًا نجحت في حل ألغاز سابقة عند التعامل مع لغز جديد، وهذه النتيجة أيضًا تشكّك في قدرة الذكاء الاصطناعي على التفكير، لأن التفكير يستدعي التعلّم من التجربة.

خلاصة الورقة البحثية كانت قاطعة: “لا يوجد دليل على استدلال منطقي رسمي في النماذج اللغوية”، وأن سلوكها “يُفسَّر بشكل أدق على أنه مطابقة متطورة للأنماط، وهي مطابقة هشّة لدرجة أن مجرد تغيير الأسماء في المسألة قد يُغيّر النتيجة”.

لكن ألا تعلم هذه النماذج لغز الفلاح؟

هذا بالضبط هو جوهر الإشكالية التي نناقشها منذ سنوات.

نعم، هذه النماذج “تعرف” لغز الفلاح من بيانات التدريب، فتعرف قواعده، وتعرف حله النموذجي، وتستطيع شرحه بإسهاب، لكن حين تتغير المعطيات ولو قليلًا، حين تُضاف مخلوقات جديدة، أو تتبدّل العلاقات بينها، ينكشف أنها كانت تُعيد إنتاج أنماط محفوظة، لا تُجري استدلالًا حقيقيًّا.

وهذا هو الفرق الجوهري بين الحفظ والفهم.

الإنسان الذي فَهِمَ لغز الفلاح يستطيع حلّه حتى لو أضفت إليه حيوانات لم يسمع بها قط، ووضعت بينها قواعد جديدة تمامًا، لأنه استوعب المبدأ، أما النموذج اللغوي، فأداؤه يتراجع بشكل ممنهج كلما ابتعد عن النماذج التي تدرّب عليها.

في المجمل، سلوكيات الذكاء الاصطناعي عند التعامل مع مسائل غير مألوفة تدعم موقف من يرى أن النماذج اللغوية أشبه بمحرك بحث متقدم بقدرات عالية على اكتشاف الأنماط في البيانات، لكن هذه القدرات لا تجعلها قادرةً على التفكير المستقل.

هل هذه المشكلة جديدة؟

لا، فهذا هو الطرح الذي دافع عنه باحثون مثل غاري ماركوس منذ عقود، وكان يُقابَل بالتشكيك والإقصاء من دوائر المتحمسين للذكاء الاصطناعي التوليدي، وقبله بسنوات طويلة، كتب ماركوس ورقته الشهيرة عام 1998 يُشير فيها إلى إخفاقات الشبكات العصبية خارج نطاق بيانات التدريب.

ثم جاءت آبل في 2024 بدراسة أولى كشفت أن تغيير الأرقام في مسائل رياضية بسيطة يُغيّر إجابات النماذج رغم أن العملية الرياضية ذاتها لم تتبدّل، واليوم، تُوسّع ورقة “وهم التفكير” هذا الإطار لتشمل نماذج الجيل الجديد، تلك التي تدّعي أنها “تُفكّر” بصوت عالٍ قبل أن تُجيب.

وتجدر الإشارة إلى أن هذه الورقة تعكس توجهًا داخليًا في آبل: الشركة لا تنظر إلى الذكاء الاصطناعي بالحماس ذاته الذي يُبديه المنافسون، ولا تُؤمن بأن هذه التقنية، بشكلها الراهن، ستُغيّر العالم على النحو الذي يُروَّج له.

فلماذا يهمّنا هذا عمليًّا؟

لأن المليارات تُضخّ في تسويق هذه الأدوات على أنها “تفكّر” و”تستنتج”، وكثير من صانعي القرار يُفوّضون إليها مهام تتطلب تكييفًا حقيقيًّا مع السياق الخاص بمؤسساتهم.

والنتائج الأكثر إثارة من ورقة آبل هي بالضبط هذا الميل إلى المبالغة في حل المشكلات البسيطة، مما يؤدي إلى حلول واقتراحات أكبر من حجم المشكلة وتخلو من الكفاءة، والمشكلة أن مثل هذه الأدوات في يد من ينسخ ويلصق فقط دون تمحيص ستُصيب صانع القرار بصداع معلوماتي حقيقي.

أما عجز النماذج عن اتباع التعليمات عند التعامل مع مسائل صعبة، فتلك مشكلة أعمق، الحلول المعلّبة نادرًا ما يمكن تطبيقها مباشرةً على الظروف الخاصة بأي مؤسسة أو شركة، والفائدة الحقيقية تكمن في تكييف المعرفة الهائلة في مخزون هذه النماذج مع السياق الخاص، وهي بالضبط القدرة التي تشكّك فيها نتائج الورقة.

وحتى لو صحّ هذا التشاؤم في تقييم قدرات التفكير، لا يعني ذلك أن الذكاء الاصطناعي بشكله الحالي لن يقود إلى تغيرات جذرية في الاقتصاد، كثير من التطبيقات التي تُستخدم فيها هذه النماذج لا تصل إلى مستوى الصعوبة الذي كشفته تجارب آبل، وباستخدام الحفظ وليس الفهم، يمكن فعليًّا استبدال كثير من المهام التي يقوم بها خريجو الجامعات، وهذا وحده كافٍ لإعادة رسم سوق العمل.

خاتمة

ورقة آبل البحثية لم تُعلن نهاية الذكاء الاصطناعي، ولم تقل إن هذه الأدوات عديمة الفائدة، بل قالت شيئًا أكثر دقةً وأكثر أهمية: إن هذه النماذج ليست ما تدّعيه، وإن ثقتنا بها يجب أن تكون متناسبة مع قدراتها الحقيقية لا مع التسويق المحيط بها.

استخدم الأداة بوعي.

اعرف حدودها قبل أن تعرف إمكاناتها.

ولا تُسمِّ الحفظ تفكيرًا، مهما بدا مُقنِعًا.

المصادر

- ورقة آبل البحثية “وهم التفكير” – مختبر تعلّم الآلة في آبل، يونيو 2025:

https://machinelearning.apple.com/research/illusion-of-thinking - تحليل IBM: “السراب الرياضي للذكاء الاصطناعي”:

https://www.ibm.com/think/news/apple-llm-reasoning - غاري ماركوس، “ضربة قاضية للنماذج اللغوية؟”:

https://garymarcus.substack.com/p/a-knockout-blow-for-llms - غاري ماركوس، “سبعة ردود على ورقة آبل الفيروسية – ولماذا تقصر”:

https://garymarcus.substack.com/p/seven-replies-to-the-viral-apple - Apple Insider، “دراسة آبل تُثبت أن النماذج اللغوية معيبة لأنها عاجزة عن الاستدلال”:

https://appleinsider.com/articles/24/10/12/apples-study-proves-that-llm-based-ai-models-are-flawed-because-they-cannot-reason